АЭЪЯОрРыЃЈBhattacharyya distance, Bhattacharyya ЯЕЪ§ЃЉ

2010-03-01 21:04:35| ЗжРрЃК

Ъ§РэЭГМЦ

| БъЧЉЃК

|ОйБЈ

|зжКХДѓжааЁ ЖЉдФ

http://en.wikipedia.org/wiki/Bhattacharyya_coefficient

http://blog.chinaunix.net/u2/61062/showart_1950751.html

ТэЪЯОрРыгаКмЖргХЕуЁЃЫќВЛЪмСПИйЕФгАЯьЃЌСНЕужЎМфЕФТэЪЯОрРыгыдЪМЪ§ОнЕФВтСПЕЅЮЛЮоЙиЃЛгЩБъзМЛЏЪ§ОнКЭжааФЛЏЪ§Он(МДдЪМЪ§ОнгыОљжЕжЎВюЃЉМЦЫуГіЕФЖўЕужЎМфЕФТэЪЯОрРыЯрЭЌЁЃТэЪЯОрРыЛЙПЩвдХХГ§БфСПжЎМфЕФЯрЙиадЕФИЩШХЁЃЫќЕФШБЕуЪЧПфДѓСЫБфЛЏЮЂаЁЕФБфСПЕФзїгУЁЃ

ВЩгУАЭЪЯОрРыЬиеїбЁдёЕФЕќДњЫуЗЈЃЌПЩвдЛёЕУзюаЁДэЮѓТЪЩЯНчЁЃЕБЬиеїЮЌЪ§ИпЪБЃЌЮЊСЫМѕЩйАЭЪЯОрРыЬиеїбЁдёМЦЫуЪБМфЃЌЖдбљБОЯШНјааK-LБфЛЛЃЌНЋЬиеїНЕЕЭЕНжаМфЮЌЪ§ЁЃШЛКѓНјааАЭЪЯОрРыЬиеїбЁдёЃЌНЕЕЭЕННсЙћЕФЮЌЪ§ЁЃгУЛљгкMNISTЪжаДЬхЪ§зжПтЕФЪдбщБэУїЃЌИУЮФЗНЗЈБШЕЅДПгУАЭЪЯОрРыЬиеїбЁдёМЦЫуЪБМфДѓДѓМѕЩйЃЌВЂБШжїЗжСПЗНЗЈ(МДЕЅДПЪЙгУK-LБфЛЛ)ЬиеїбЁдёЕФДэЮѓТЪаЁЕУЖр

дкЭГМЦбЇжаЃЌАЭЪЯОрРыЃЈАЭЫўЧЁРябХОрРы / Bhattacharyya distanceЃЉгУгкВтСПСНРыЩЂИХТЪЗжВМЁЃЫќГЃдкЗжРржаВтСПРржЎМфЕФПЩЗжРыадЁЃ

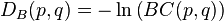

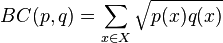

дкЭЌвЛЖЈвхгђXжаЃЌИХТЪЗжВМpКЭqЕФАЭЪЯОрРыЖЈвхШчЯТЃКЦфжаЃЈ1ЃЉРыЩЂИХТЪЗжВМКЭЃЈ2ЃЉСЌајИХТЪЗжВМ

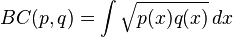

BCЪЧАЭЪЯЯЕЪ§ЃЈBhattacharyya coefficientЃЉЁЃ

ХЗЪНОрРыКЭТэЪЯОрРыКЭАЭЪНОрРыЃЈзЊЃЉ

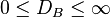

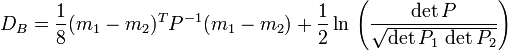

| ХЗЪЯОрРыЃКЃЈЁЦЃЈXi-YiЃЉ2ЃЉ1/2ЃЌМДСНЯюМфЕФВюЪЧУПИіБфСПжЕВюЕФЦНЗНКЭдйЦНЗНИљЃЌФПЕФЪЧМЦЫуЦфМфЕФећЬхОрРы МДВЛЯрЫЦадЁЃ ЮвУЧЪьЯЄЕФХЗЪЯОрРыЫфШЛКмгагУЃЌЕЋвВгаУїЯдЕФШБЕуЁЃЫќНЋбљЦЗЕФВЛЭЌЪєадЃЈМДИїжИБъЛђИїБфСПЃЉжЎМфЕФВюБ№ЕШ ЭЌПДД§ЃЌетвЛЕугаЪБВЛФмТњзуЪЕМЪвЊЧѓЁЃР§ШчЃЌдкНЬг§баОПжаЃЌОГЃгіЕНЖдШЫЕФЗжЮіКЭХаБ№ЃЌИіЬхЕФВЛЭЌЪєадЖд гкЧјЗжИіЬхгазХВЛЭЌЕФживЊадЁЃвђДЫЃЌгаЪБашвЊВЩгУВЛЭЌЕФОрРыКЏЪ§ЁЃ ШчЙћгУdijБэЪОЕкiИібљЦЗКЭЕкjИібљЦЗжЎМфЕФОрРыЃЌФЧУДЖдвЛЧаiЃЌjКЭkЃЌdijгІИУТњзуШчЯТЫФИіЬѕМўЃК ЂйЕБЧвНіЕБi=jЪБЃЌdij=0 ЂкdijЃО0 ЂлdijЃНdjiЃЈЖдГЦадЃЉ ЂмdijЁмdikЃЋdkjЃЈШ§НЧВЛЕШЪНЃЉ ЯдШЛЃЌХЗЪЯОрРыТњзувдЩЯЫФИіЬѕМўЁЃТњзувдЩЯЬѕМўЕФКЏЪ§гаЖржжЃЌБОНкНЋвЊгУЕНЕФТэЪЯОрРывВЪЧЦфжаЕФвЛжжЁЃ ЕкiИібљЦЗгыЕкjИібљЦЗЕФТэЪЯОрРыdijгУЯТЪНМЦЫуЃК dij=(xiвЛxj)'S-1(xiвЛxj) ЦфжаЃЌxiКЭxjЗжБ№ЮЊЕкiИіКЭЕкjИібљЦЗЕФmИіжИБъЫљзщГЩЕФЯђСПЃЌSЮЊбљБОаЗНВюОиеѓЁЃ ТэЪЯОрРыгаКмЖргХЕуЁЃЫќВЛЪмСПИйЕФгАЯьЃЌСНЕужЎМфЕФТэЪЯОрРыгыдЪМЪ§ОнЕФВтСПЕЅЮЛЮоЙиЃЛгЩБъзМЛЏЪ§ОнКЭжа аФЛЏЪ§Он(МДдЪМЪ§ОнгыОљжЕжЎВюЃЉМЦЫуГіЕФЖўЕужЎМфЕФТэЪЯОрРыЯрЭЌЁЃТэЪЯОрРыЛЙПЩвдХХГ§БфСПжЎМфЕФЯрЙиадЕФ ИЩШХЁЃЫќЕФШБЕуЪЧПфДѓСЫБфЛЏЮЂаЁЕФБфСПЕФзїгУЁЃ In statistics, the Bhattacharyya distance measures the similarity of two discrete probability distributions. It is normally used to measure the separability of classes in classification. For discrete probability distributions p and q over the same domain X, it is defined as:  where:  is the Bhattacharyya coefficient. For continuous distributions, the Bhattacharyya coefficient is defined as:  In either case,  and and  . DB need not obey the triangle inequality, but . DB need not obey the triangle inequality, but  does obey the triangle inequality. does obey the triangle inequality. For multivariate Gaussian distributions pi = N(mi,Pi),  , , where mi and Pi are the means and covariances of the distributions, and  . . Note that the first term in the Bhattacharyya distance is related to the Mahalanobis distance.ЃЈАЭЪНОрРыКЭТэЪЯОрРыжЎМфЕФЙиЯЕЃЉ | | |

ЦРТлетеХ

зЊЗЂжСЮЂВЉ

зЊЗЂжСЮЂВЉ

зЊЗЂжСЮЂВЉ

зЊЗЂжСЮЂВЉ

дФЖС(9976)|

ЦРТл()

|

гУЮЂаХ ЁАЩЈвЛЩЈЁБ

НЋЮФеТЗжЯэЕНХѓгбШІЁЃ

гУвзаХ ЁАЩЈвЛЩЈЁБ

НЋЮФеТЗжЯэЕНХѓгбШІЁЃ

ЯВЛЖ

ЭЦМі

2ШЫ |

зЊди

ЙиБе

ЭцLOFTERЃЌУтЗбГхгЁ20еХееЦЌЃЌШЫШЫгаНБЃЁ

ЮввЊЧР>

<#--зюаТШежОЃЌШКВЉШежО-->

<#--ЭЦМіШежО-->

<#--в§гУМЧТМ-->

<#--ВЉжїЭЦМі-->

<#--ЫцЛњдФЖС-->

<#--ЪзвГЭЦМі-->

<#--РњЪЗЩЯЕФНёЬь-->

<#--БЛЭЦМіШежО-->

<#--ЩЯвЛЦЊЃЌЯТвЛЦЊ-->

<#-- ШШЖШ -->

<#-- ЭјвзаТЮХЙуИц -->

<#--гвБпФЃПщНсЙЙ-->

<#--ЦРТлФЃПщНсЙЙ-->

<#--в§гУФЃПщНсЙЙ-->

<#--ВЉжїЗЂЦ№ЕФЭЖЦБ-->

ЦРТл